Hur kombinationer av sensorer gör det möjligt för autonoma mobila robotar att navigera effektivt på fabriksgolvet

Bidraget med av DigiKeys nordamerikanska redaktörer

2024-03-27

När allt fler människor och autonoma mobila robotar (AMR), även kallade mobila industrirobotar, arbetar i samma område måste man ta hänsyn till flera naturliga säkerhetsrisker. Säker och effektiv drift av autonoma mobila robotar är alldeles för viktigt för att förlita sig på en enda sensorteknik.

Tekniken med en kombination av flera sensorer, som t.ex. laseravståndsmätare (LiDAR), kameror, ultraljudssensorer, lasersensorer för att upptäcka hinder och radiofrekvensidentifiering (RFID) används för att stödja en rad olika funktioner hos autonoma mobila robotar, inklusive navigering, färdplanering, undvikande av kollisioner, lagerhantering och logistikstöd. Kombinationen av sensorer innefattar även att varna människor i närheten för förekomsten av autonoma mobila robotar.

För att tillgodose behovet av säker och effektiv drift för autonoma mobila robotar utvecklar ANSI (American National Standards Institute) och A3 (Association for Advancing Automation), tidigare RIA (Robotic Industries Association), standarden ANSI/A3 R15.08. Standarderna R15.08-1 och R15.08-2 har publicerats, med fokus på grundläggande säkerhetskrav och integrering av autonoma mobila robotar i en anläggning. Standarden R15.08-3 är för närvarande under utveckling och kommer att utöka säkerhetskraven för autonoma mobila robotar, inklusive mer detaljerade rekommendationer för användning av flera kombinerade sensorer.

I väntan på standarden R15.08-3 granskar den här artikeln några av dagens bästa metoder för säkerhet och kombinering av sensorer i autonoma mobila robotar. Artikeln inleder med en kort översikt över de krav på funktionssäkerhet som för närvarande gäller för autonoma mobila robotar, inklusive generiska standarder för industriell säkerhet som t.ex. standarderna IEC 61508, ISO 13849 och IEC 62061 samt säkerhetskraven för att känna av mänsklig närvaro, som t.ex. standarderna IEC 61496 och IEC 62998. Därefter presenteras en typisk konstruktion av en autonom mobil robot som fokuserar på de olika sensorteknikerna, presenterar referensenheter och tittar på hur de stödjer funktioner som t.ex. navigering, färdplanering, undvikande av kollision samt lagerhantering/logistikstöd.

Bra, bättre, bäst

Konstruktörer av autonoma mobila robotar har en rad olika säkerhetsstandarder att ta hänsyn till, med de allmänna standarderna för funktionssäkerhet, som t.ex. IEC 61508, ISO 13849 och IEC 62061 som grund. Det finns också mer specifika säkerhetsstandarder som är relaterade till att känna av mänsklig närvaro, som t.ex. standarderna IEC 61496, IEC 62998 och ANSI/A3 R15.08.

Standarden IEC 61496 ger vägledning för flera olika typer av sensorer. Den hänvisar till standarden IEC 62061, som specificerar krav och ger rekommendationer avseende konstruktion, integrering och validering av elektriskt avkännande skyddsanordningar för maskiner, inklusive säkerhetsintegritetsnivåer (SIL), och ISO 13849 som styr maskinsäkerhet och säkerhetsrelaterade delar av styrsystem, inklusive prestandanivåer (PL) för säkerhet (tabell 1).

|

|||||||||||||||||||

Tabell 1: Säkerhetskrav för elektriskt avkännande skyddsanordningar per typ enligt IEC 61496. (Tabellkälla: Analog Devices)

Standarden IEC 62998 är nyare och kan ofta vara ett bättre val eftersom den innehåller råd för implementering av kombinationer av sensorer, användning av artificiell intelligens (AI) i säkerhetssystem och användning av sensorer monterade på rörliga plattformar som inte omfattas av standarden IEC 61496.

Standarden R15.08 del 3, när den släpps, kan göra standarden R15.08 till den bästa eftersom den kommer att lägga till säkerhetskrav för användare som nyttjar system med autonoma mobila robotar och tillämpningar med autonoma mobila robotar. Troliga ämnen kan vara kombinationer av sensorer och mer omfattande stabilitetstestning och validering av autonoma mobila robotar.

Funktioner med kombinerade sensorer

En kartläggning av anläggningen är en viktig aspekt vid driftsättning av autonoma mobila robotar. Men, det är inte något som sker vid endast ett tillfälle och aldrig mer. Det är även en del av en ständig process som kallas samtidig positionering och kartläggning (SLAM), ibland även kallad synkroniserad positionering och kartläggning. Processen används för att kontinuerligt uppdatera kartan över ett område samtidigt som man håller reda på robotens position.

Kombinationer av sensorer behövs för att stödja samtidig positionering och kartläggning och möjliggöra säker drift av autonoma mobila robotar. Alla sensorer fungerar inte lika bra vid alla driftsförhållanden och olika sensortekniker levererar olika typer av data. Artificiell intelligens kan användas i system med kombinationer av sensorer för att kombinera information om den lokala driftmiljön (är det dimmigt eller rökigt, fuktigt, hur starkt är det omgivande ljuset etc.) och möjliggöra ett mer betydelsefullt resultat genom att kombinera utdata från olika sensortekniker.

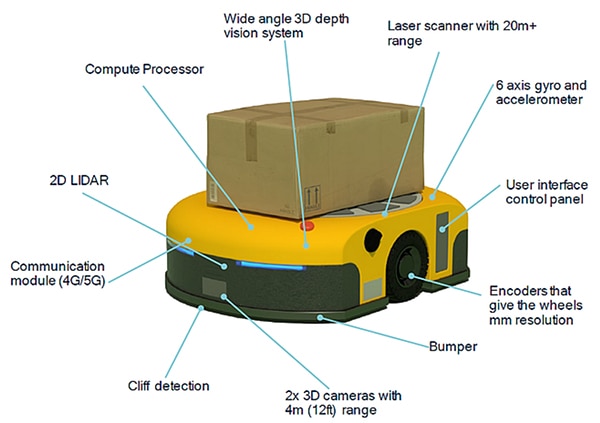

Sensorer kan kategoriseras utifrån funktion såväl som teknik. Exempel på kombinationer av sensorer i autonoma mobila robotar är (figur 1):

- Avståndssensorer som t.ex. kodare på hjul och tröghetsmätare med gyroskop och accelerometrar som hjälper till att mäta rörelsen och bestämma avståndet mellan referenspositioner.

- Bildsensorer, som t.ex. tredimensionella kameror och LiDAR med tredimensionell teknik, används för att identifiera och spåra närliggande objekt.

- Kommunikationslänkar, beräkningsprocessorer och logistiksensorer, som t.ex. streckkodsläsare och RFID-enheter, kopplar samman autonoma mobila robotar med anläggningens ledningssystem och integrerar informationen från externa sensorer till autonoma mobila robotars kombinationer av sensorer för förbättrad prestanda.

- Närhetssensorer, som t.ex. laserskannrar och LiDAR med tvådimensionell teknik, upptäcker och spårar objekt i närheten av autonoma mobila robotar, inklusive människors rörelser.

Figur 1: Exempel på vanliga typer av sensorer och tillhörande systemdelar som används i konstruktioner med kombinationer av sensorer för autonoma mobila robotar. (Bildkälla: Qualcomm)

Figur 1: Exempel på vanliga typer av sensorer och tillhörande systemdelar som används i konstruktioner med kombinationer av sensorer för autonoma mobila robotar. (Bildkälla: Qualcomm)

LiDAR med två- respektive tredimensionell teknik och ultraljud

LiDAR med två- respektive tredimensionell teknik och ultraljud är vanliga sensortekniker som stödjer samtidig positionering och kartläggning och säkerhet i autonoma mobila robotar. Skillnaderna mellan dessa tekniker gör att en sensor kan kompensera för svagheterna hos de andra sensorerna och därmed förbättra prestanda och tillförlitlighet.

LiDAR med tvådimensionell teknik använder ett enda plan med laserbelysning för att identifiera objekt baserat på X- och Y-koordinater. LiDAR med tredimensionell teknik använder flera laserstrålar för att skapa en mycket detaljerad tredimensionell representation av omgivningen, ett så kallat punktmoln. Båda typerna av LiDAR är relativt okänsliga för omgivande ljusförhållanden men kräver att de objekt som ska detekteras har en lägsta reflektivitetgräns för den våglängd som lasern sänder ut. I allmänhet kan LiDAR med tredimensionell teknik detektera objekt med låg reflektionsförmåga med större tillförlitlighet än LiDAR med tvådimensionell teknik.

Sensorn HPS-3D160 för LiDAR med tredimensionell teknik från Seeed Technology integrerar mycket effektiva infraröda VCSEL-sändare (Vertical Cavity Surface Emitting Laser) på 850 nm och mycket ljuskänsliga CMOS-kretsar. Den inbyggda och mycket effektiva processorn innehåller algoritmer för filtrering och kompensering och kan stödja flera LiDAR-enheter samtidigt. Enheten har en räckvidd på upp till 12 m med centimeternoggrannhet.

När en LiDAR med tvådimensionell teknik behövs kan konstruktörer använda sig av TIM781S-2174104 från SICK. Den har en bländarvinkel på 270 grader med en vinkelupplösning på 0,33 grader och en skanningsfrekvens på 15 Hz. Den har ett säkerhetsrelaterat arbetsområde på 5 m (figur 2).

Figur 2: Sensorn för LiDAR med tvådimensionell teknik har en bländarvinkel på 270 grader. (Bildkälla: SICK)

Figur 2: Sensorn för LiDAR med tvådimensionell teknik har en bländarvinkel på 270 grader. (Bildkälla: SICK)

Ultraljudssensorer kan noggrannt detektera genomskinliga objekt som t.ex. glas och ljusabsorberande material som LiDAR inte alltid kan upptäcka. Ultraljudssensorer är mindre känsliga för störningar orsakade av mycket damm, rök, luftfuktighet och även andra förhållanden som kan störa LiDAR. Ultraljudssensorer är dock känsliga för störningar från omgivande ljud och detekteringsområdet kan vara mer begränsat än för LiDAR.

Ultraljudssensorer som t.ex. TSPC-30S1-232 från Senix kan komplettera LiDAR och andra sensorer med samtidig positionering, kartläggning och säkerhet för autonoma mobila robotar. Den har en optimal räckvidd på 3 m, jämfört med 5 respektive 12 m för de LiDAR med två- respektive tredimensionell teknik som beskrivs ovan. Den temperaturkompenserande ultraljudssensorn är klassificerad enligt IP68 och är placerad i ett miljötätat hölje av rostfritt stål (figur 3).

Figur 3: Miljötätad ultraljudssensor med en optimal räckvidd på 3 m. (Bildkälla: DigiKey)

Figur 3: Miljötätad ultraljudssensor med en optimal räckvidd på 3 m. (Bildkälla: DigiKey)

Kombinationer av sensorer innebär vanligtvis att flera diskreta sensorer används. Men i vissa fall paketeras flera sensorer tillsammans som en enda enhet.

Tre sensorer i en

Visuell perception med hjälp av ett par kameror för att åstadkomma stereoskopiska bilder samt bildbehandling baserad på artificiell intelligens och maskininlärning kan göra det möjligt för autonoma mobila robotar att se bakgrunden och identifiera närliggande objekt. Det finns sensorer som inkluderar stereokameror för djupseende, en separat färgkamera och en tröghetsmätare i en och samma enhet.

Stereokameror för djupseende, som t.ex. D455 RealSense Depth Cameras från Intel RealSense, använder två kameror som är åtskilda av en känd baslinje för att känna av djupet och beräkna avståndet till ett objekt. Användning av en robust stålram som säkerställer ett exakt avstånd mellan kamerorna, även i krävande industrimiljöer, är avgörande för precisionen. Noggrannheten i algoritmen för djupuppfattning är beroende av det exakta avståndet mellan de två kamerorna.

Kameramodellen 82635DSD455MP har till exempel optimerats för autonoma mobila robotar och liknande plattformar, och avståndet mellan kamerorna har utökats till 95 mm (figur 4). Det gör att algoritmen för beräkning av djup kan minska uppskattningsfelet till mindre än 2 % vid 4 m.

Figur 4: Modulen innehåller stereokameror med djupseende med ett avstånd på 95 mm, en separat färgkamera och en tröghetsmätare. (Bildkälla: DigiKey)

Figur 4: Modulen innehåller stereokameror med djupseende med ett avstånd på 95 mm, en separat färgkamera och en tröghetsmätare. (Bildkälla: DigiKey)

Djupkameran D455 innehåller även en separat färgkamera (RGB). Färgkamerans globala slutare för upp till 90 bilder per sekund, som anpassas till djupkamerans synfält, förbättrar överensstämmelsen mellan färg- och djupbilder, vilket ökar förmågan att förstå omgivningen. Djupkameran D455 integrerar en tröghetsmätare med sex rörelseriktningar som gör att algoritmen för beräkningen av djupet kan inkludera autonoma mobila robotars hastighet och återge dynamiska uppskattningar av djupet.

Ljus och ljud längs vägen

Blinkande lampor och varningsljud för personer i närheten av en autonom mobil robot är viktiga för säkerheten. Ljusen består vanligtvis av ett ljustorn eller en ljusramp på de autonoma mobila robotarnas sidor. De hjälper roboten att kommunicera sina avsikter till människor. De kan också indikera status som t.ex. batteriladdning, lastning eller lossning, avsikt att svänga i en ny riktning (som körriktningsvisare på en bil), nödsituationer med mera.

Det finns inga standarder för ljusens färger, blinkandets hastighet eller larmljuden. De kan variera mellan olika tillverkare av autonoma mobila robotar och utvecklas ofta för att återspegla de specifika aktiviteterna i den anläggning där den autonoma mobila roboten verkar. Ljustornen finns med eller utan inbyggda mekanismer för varningsljud. Modellen TLF100PDLBGYRAQP från Banner Engineering har till exempel ett förseglat ljudelement med 14 valbara toner och volymkontroll (figur 5).

Figur 5: Ljustornet innehåller ett förseglat ljudelement (övre svarta cirkeln). (Bildkälla: DigiKey)

Figur 5: Ljustornet innehåller ett förseglat ljudelement (övre svarta cirkeln). (Bildkälla: DigiKey)

Logistikstöd

Autonoma mobila robotar används som en del i en större verksamhet och måste ofta integreras med affärssystem (ERP), tillverkningssystem (MES) eller lagerhanteringssystem (WMS). Kommunikationsmodulen på den autonoma mobila roboten tillsammans med sensorer som t.ex. läsare för streckkod och RFID gör det möjligt att integrera autonoma mobila robotar i affärssystem.

När en streckkodsläsare behövs kan konstruktörer använda sig av V430-F000W12M-SRP från Omron. Den kan avkoda en- och tvådimensionella streckkodsetiketter eller permanenta streckkoder (Direct Part Mark barcodes). Den har autofokus med variabelt avstånd, ett objektiv med brett synfält, en sensor på 1,2 megapixel, en inbyggd lampa och bearbetning i hög hastighet.

DLP-RFID2 från DLP Design är en prisvärd och kompakt modul för läsning från och skrivning till högfrekventa (HF) RFID-transponderenheter. Den kan också läsa de unika identifierarna (UDI) för upp till 15 enheter samtidigt och kan konfigureras för att använda en intern eller extern antenn. Den har ett driftstemperaturområde på mellan 0 och +70 °C vilket gör den lämplig för användning i tillverknings- och logistikanläggningar för Industry 4.0.

Sammanfattning

En kombination av sensorer är viktigt för att stödja samtidig positionering och kartläggning och säkerhet i autonoma mobila robotar. I väntan på standarden R15.08-3, som kan innehålla referenser till kombinationer av sensorer och mer omfattande stabilitetstestning och validering för autonoma mobila robotar, har vi i den här artikeln granskat några aktuella standarder och bästa metoder för implementering av kombinationer av sensorer i autonoma mobila robotar. Det här är den andra artikeln i en serie av två delar. Del ett handlade om säker och effektiv integrering av autonoma mobila robotar för maximal nytta i verksamheter med Industry 4.0.

Disclaimer: The opinions, beliefs, and viewpoints expressed by the various authors and/or forum participants on this website do not necessarily reflect the opinions, beliefs, and viewpoints of DigiKey or official policies of DigiKey.